Ihr Handy wird Ihnen sagen, was es sieht und wo sich Ihre Brille befindet. Google hat auf der I/O 2024 eine Menge KI-Neuheiten vorgestellt (VIDEO WIRD IM ARTIKEL ANGEZEIGT)

• Autor: Matej Toul

Das Unternehmen Google präsentiert seine technologischen Innovationen traditionell auf der Präsentation Google I/O 2024. In diesem Jahr ging es jedoch etwas anders zu. Der Hersteller zeigte bereits vor einer Woche das neue Google Pixel 8a, verschob die Vorstellung des kommenden Android 15 aber auf später. Warum? Damit die gesamte Präsentation der künstlichen Intelligenz gewidmet werden konnte. Wie am Ende erwähnt, wurde das Wort „KI“ in weniger als zwei Stunden I/O genau 121 Mal erwähnt, und es gibt wirklich vieles Neues. Werfen wir einen Blick auf die interessantesten.

Google I/O 2024 – INHALT

- Project Astra ist ein Assistent, der in Echtzeit per Telefon oder Brille reagiert

- Google Gemini kann über viel Kontext nachdenken, bis zum Ende des Jahres noch mehr

- Es stehen nun zwei Gemini Hauptmodelle zur Auswahl

- Veo und Imagen 3 sind neue generative KI-Modelle von Google

- Künstliche Intelligenz wird ein fester Bestandteil der Google-Suche werden

- Gemini für Google Workspace ermöglicht die anwendungsübergreifende Automatisierung

- AI Agent kann eine Reklamation für Sie erledigen oder einen Urlaub planen

- Eine bessere KI erfordert zwangsläufig bessere Hardware

Project Astra ist ein Assistent, der in Echtzeit per Telefon oder Brille reagiert

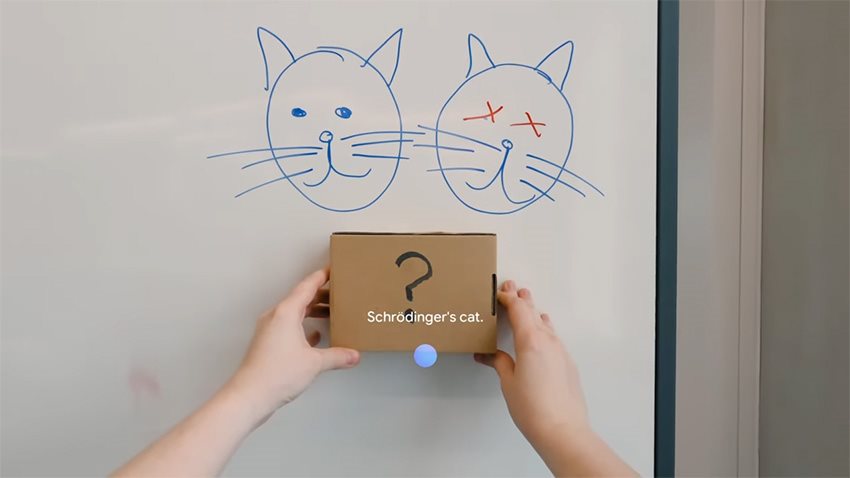

Wenn es eine Sache gibt, die Sie von Google I/O 2024 mitnehmen möchten, die die KI einen großen Sprung nach vorne gebracht hat, dann ist es Project Astra. Nachdem die OpenAI-Organisation am Tag vor der I/O ihren KI-Assistenten mit Echtzeit-Antworten angekündigt hatte, der auch durch die Handy-Kamera „sehen“ kann, sah es so aus, als ob Google noch viel Arbeit vor sich hätte, um mit der Konkurrenz mithalten zu können. Allerdings war die Internet-Nummer eins mit ihrer Antwort mehr als vorbereitet.

Project Astra ist eine praktische und, wie das Video unten zeigt, sehr praktische Umsetzung eines KI-Modells als persönlicher Assistent, der in Echtzeit auf Videoeingaben reagieren und diese verarbeiten kann. In seiner Demo zeigte Google unter anderem die große Fähigkeit des Assistenten, mit Kontext zu arbeiten und sich scheinbar irrelevante Dinge aus einem Video zu merken (z. B. wo Sie Ihre Brille gelassen haben), und das alles nicht nur am Telefon, sondern auch in einer smarten Brille. Das Demo-Video unten sagt alles.

Project Astra soll eventuell den klassischen Google Assistant in Handys mit dem Android-Betriebssystem ersetzen. Obwohl Google noch nichts direkt gesagt hat, dürfte diese Änderung noch vor Jahresende erfolgen und könnte eine der Hauptattraktionen des kommenden Android 15 sein, worüber wir in den folgenden Tagen mehr erfahren sollten.

i

Google Pixel 8a (VORSTELLUNG): Mittelklasse mit Flaggschiff- Ausstattung und 7 Jahre Unterstützung

Google Gemini kann über viel Kontext nachdenken, bis zum Ende des Jahres noch mehr

Wir haben über Google Gemini bereits in der Vergangenheit gehört. Es ist derzeit das meistgenutzte KI-Produkt von Google und steht in direkter Konkurrenz zu Tools wie ChatGPT von OpenAI oder Microsoft Copilot in der Bing-Suchmaschine. Eines der Hauptmerkmale dieses Modells ist die Multimodalität im Kern – Gemini wurde von Anfang an als Werkzeug zur Verarbeitung oder Generierung von Text, Bildern, Videos, Code usw. konzipiert, während andere Modelle nur um diese Funktionen im Laufe der Zeit erweitert wurden und oft als Zwischenschritt noch Text generiert haben.

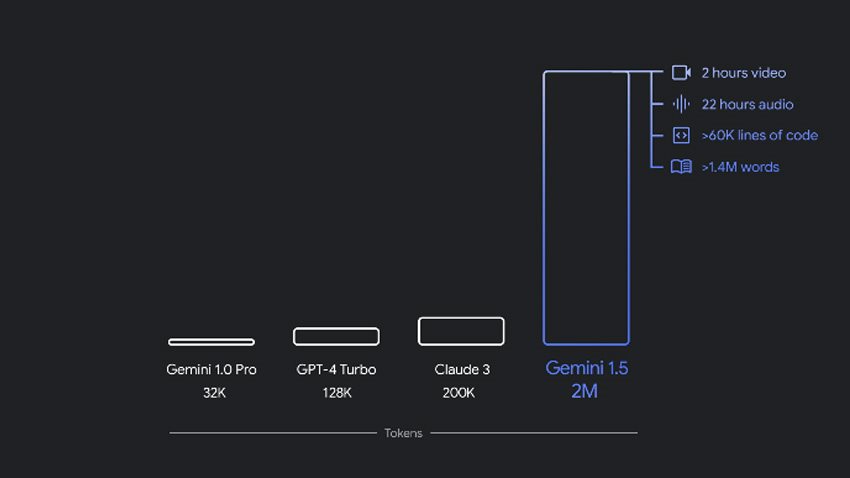

Worin Google Gemini derzeit allerdings einen deutlichen Vorteil gegenüber der Konkurrenz hat, ist die Größe des sogenannten „Kontextfensters“. Sie können sich das als die Menge an Informationen vorstellen, die Sie eingeben und über die die künstliche Intelligenz in einem Moment nachdenken kann. Derzeit kann das Topmodell Google Gemini 1.5 Pro durchweg über 1 Million Tokens verarbeiten. Das sind ungefähr 10 Stunden Audio, 1 Stunde Video oder 700.000 Wörter Text. Google hat seine Pläne bekannt gegeben, das Kontextfenster bis Ende 2024 auf 2 Millionen Token zu erweitern.

Darüber hinaus wird die Chat-Version des Gemini-Modells nun voreingestellte Chat-Fenster unterstützen, ähnlich wie wir es bereits bei der Konkurrenz gesehen haben. Google hat diese Funktion „Gemini Gems“ genannt. Beispielsweise wird es möglich sein, ein Gem eines persönlichen Kochs zu erstellen, dem Sie eine Beschreibung hinzufügen können, an die es bei jedem Start denken wird. Es stellt sich heraus: Wenn man dem Chat vermittelt, dass er ein Michelin-Koch mit jahrelanger Erfahrung ist, kann seine Leistung tatsächlich noch ein wenig besser sein. Beispielsweise können Sie der Beschreibung den gewünschten Antwortstil hinzufügen. Alle Antworten folgen dann dem von Ihnen angegebenen Format.

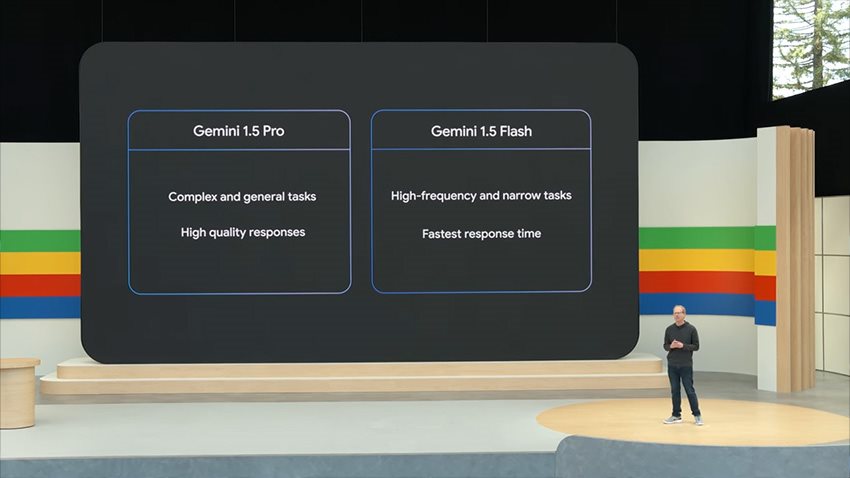

Es stehen nun zwei Gemini Hauptmodelle zur Auswahl

Das bisher beste Modell der Gemini-Familie war das Google Gemini 1.5 Pro. Daran ändert sich nichts, allerdings hat Google mit Gemini 1.5 Flash eine neue Alternative eingeführt. Es handelt sich um ein leichtes Modell, das schnellstmögliche Antworten liefern soll. Es verfügt über alle Vorteile von Gemini, d. h. Multimodalität und ein langes Kontextfenster, allerdings werden die Antworten in der Regel etwas schlechter sein als beim Pro-Modell.

Der Haupteinsatzbereich des Gemini 1.5 Flash-Modells werden Anwendungen sein, die mit einer großen Anzahl eher einfacher Anfragen arbeiten, die so schnell wie möglich verarbeitet werden müssen. Wenn Sie aufwändige Detailausgaben benötigen und nichts dagegen haben, etwas länger zu warten, empfiehlt Google dennoch die Pro-Variante.

Auch preislich sind die Modelle sehr interessant. Wenn Sie sie außerhalb von Google-Anwendungen verwenden, d. h. in Form einer API (einer Programmierschnittstelle, die die Integration von KI in verschiedene Anwendungen von Drittanbietern ermöglicht), kosten 1 Million Abfragetokens in Gemini 1.5 Pro 7 US-Dollar. Wenn Ihre einzelnen Abfragen weniger als 128.000 Token umfassen, ist der Preis sogar noch niedriger, Sie zahlen 3,5 Dollar pro Million Abfrage-Token. Aber Gemini 1.5 Flash ist ein wirklich lukratives Angebot. Die Preise für die Nutzung dieses Modells beginnen bei nur 35 Cent für 1 Million Abfrage-Tokens.

Zum Vergleich: Das GPT-4 Turbo-Modell von OpenAI, das maximal 128.000 Token gleichzeitig unterstützt, kostet Sie 10 US-Dollar pro Million Abfrage-Token.

Veo und Imagen 3 sind neue generative KI-Modelle von Google

Ein großer Teil der Präsentation war auch dem Thema generative künstliche Intelligenz gewidmet. Das Veo-Modell zur Text-zu-Video-Generierung, das verbesserte Imagen 3-Modell zur Text-zu-Bild-Generierung und nicht zuletzt das Music AI Sandbox AI-Toolkit zur Musikgenerierung wurden vorgestellt.

Das neue Veo-Modell ist in der Lage, Videos in Full-HD-Auflösung in verschiedenen Stilrichtungen zu erstellen, die länger als eine Minute dauern. Das Imagen 3-Modell konzentriert sich hauptsächlich auf Details. Es kann selbst die spezifischsten Anforderungen originalgetreu darstellen und wirklich fotorealistische Bilder erzeugen. In diesem Fall macht es keinen Sinn, die Ausgänge zu beschreiben – sehen Sie sich das Demo-Video unten an.

Alles, was Gemini generiert (neu auch Videos), wird mit einem unveränderlichen SynthID-„Wasserzeichen“ versehen, um die Verbreitung falscher Informationen und die Weitergabe generierter Inhalte zu verhindern.

Google sprach auch kurz über seine Familie offener Modelle Gemma, die von jedem frei genutzt werden können. Das PaliGemma-Modell wird beispielsweise für die Bilderkennung zu Zwecken der Zugänglichkeit verwendet, während CodeGemma speziell für die Unterstützung bei der Programmierung trainiert wurde. Google hat auch ein neues offenes Universalmodell, Gemma 2, vorgestellt, über das wir in den kommenden Wochen mehr erfahren werden.

Künstliche Intelligenz wird ein fester Bestandteil der Google-Suche werden

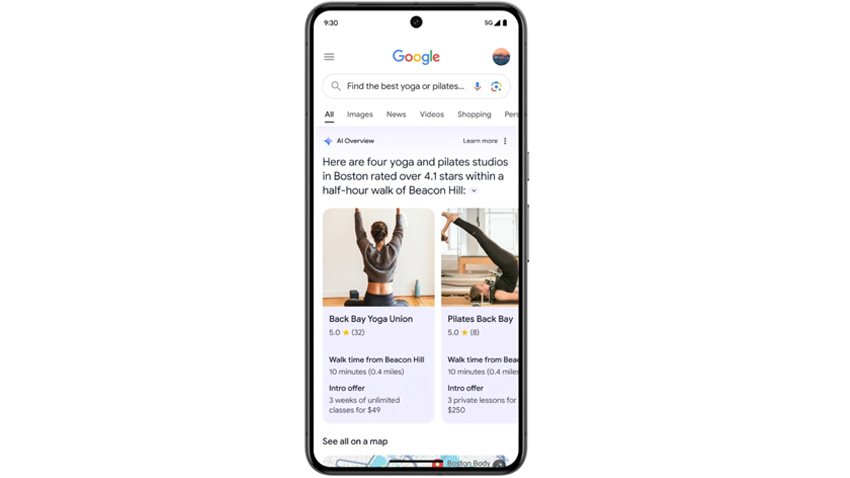

Tests von Google Gemini in der Google-Suche laufen schon seit einiger Zeit. Auf der Google I/O 2024 bekamen wir eine Vorschau darauf, was KI bei der Suche leisten kann. Zu den Hauptfunktionen gehören Zusammenfassungen – Gemini fasst die Informationen aus den von Ihnen gesuchten Artikeln zusammen und liefert Ihnen ein kurzes und übersichtliches Ergebnis, wobei alle Quellen hinzugefügt werden, wenn Sie mehr erfahren möchten.

Die Suche ist auch in der Lage, komplexere Anfragen zu bearbeiten. Die Präsentation zeigte die Abfrage „Finden Sie das beste Yoga- oder Pilates-Studio in Boston, zeigen Sie mir Details zu den Angeboten für Anfänger und zu Fuß zu Beacon Hill.“ Google Gemini kann die Anfrage in Schritte unterteilen, alle erforderlichen Informationen abrufen und sie Ihnen schließlich umfassend in einer übersichtlichen Blockoberfläche präsentieren, die an Ihre Suche angepasst ist.

Darüber hinaus wird die Suche wieder multimodal sein – Video (wahrscheinlich basierend auf Project Astra) wird zur bereits bestehenden Suche nach Text, Sprache und Bildern hinzugefügt.

Google gab bekannt, dass es nach vielen Tests bereit sei, künstliche Intelligenz in der Suche öffentlich freizugeben. Die Funktion soll diese Woche für Benutzer in den USA verfügbar sein, während für den Rest der Welt nur ein vages „bald“ zu hören ist.

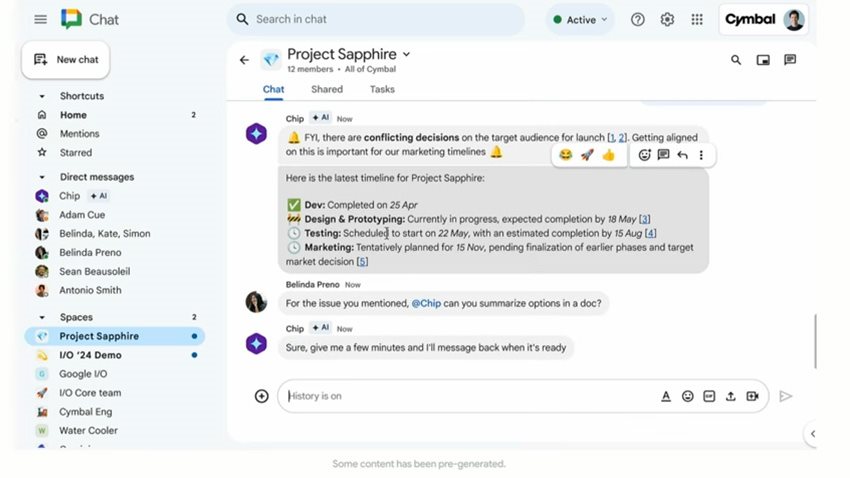

Gemini für Google Workspace ermöglicht die anwendungsübergreifende Automatisierung

Eine weitere Verwendung für Gemini wurde von Google in der Google Workspace-Umgebung gefunden. Es handelt sich um ein Business-Paket beliebter Produkte wie Gmail, Google Drive, Google Kalender, Google Docs und mehr – in einer App, mit zusätzlichen Funktionen. Google Gemini kann hier als neuer „Kollege“ hinzugefügt werden. Müssen Sie Rechnungen aus E-Mails an einem Ort organisieren? Für Gemini stellt dies kein Problem dar, und bei dieser Gelegenheit erstellt es für Sie eine Einnahmen- und Ausgabentabelle, ergänzt durch entsprechende Grafiken.

Sie können Gemini auch in Gruppenchats verwenden, genau wie mit Kollegen. Möchten Sie sicherstellen, dass eine neue Version Ihres Produkts zur Veröffentlichung bereit ist? Fragen Sie einfach, und wenn keiner Ihrer echten Kollegen da ist, um zu antworten, geht Gemini alle Dateien und Daten durch, auf die es Zugriff hat, weist auf mögliche Probleme hin und schlägt die nächste Vorgehensweise vor.

Ein anderer Kollege kann leicht auf Geminis Output reagieren, indem er beispielsweise eine anspruchsvolle Aufgabe eingibt, die normalerweise Stunden dauern würde. Gemini wird in ein paar Minuten mit der Ausgabedatei zurück sein.

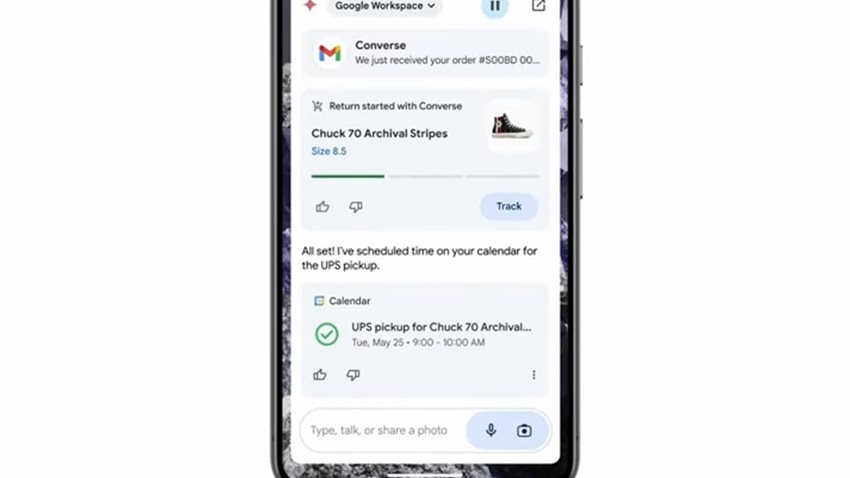

AI Agent kann eine Reklamation für Sie erledigen oder einen Urlaub planen

Gemini klingt als Kollege in Google Workspace großartig, ist aber immer noch ein rein professionelles Tool, das die meisten Nutzer wahrscheinlich nicht nutzen werden. Aber Google möchte künstliche Intelligenz wirklich jedem zugänglich machen. Daher die sogenannte KI-Agenten. Im Grunde handelt es sich um eine sehr fortschrittliche Verbindung von allem, was Google AI zu bieten hat. Der Agent plant die gegebene Aufgabe in mehreren Schritten und kann softwareübergreifend arbeiten.

Auf der Google I/O 2024 sahen wir eine sehr häufige Situation. Sie haben Schuhe gekauft, aber die Größe passt nicht – geben Sie einfach einen Befehl an den KI-Agenten. Dann geht er Ihre E-Mails durch und findet die Rechnung, findet heraus, wo Sie die Schuhe gekauft haben und alle für die Rücksendung wichtigen Informationen, füllt das Reklamationsformular aus und teilt Ihnen einfach mit, wohin Sie die Schuhe bringen sollen, oder beauftragt sogar die Abholung.

Gleichzeitig hätten Sie die Kontrolle über all diese Schritte – der AI Agent plant und erledigt alles für Sie, aber bevor er etwas tut, was Sie vielleicht nicht möchten, wird er Sie immer um Ihre Bestätigung bitten. Bei der Präsentation wurde mehrfach erwähnt, dass die Kontrolle über den gesamten Prozess eine der höchsten Prioritäten ist. Google weist jedoch darauf hin, dass sich diese Technologie noch in der frühen Entwicklung befindet und wir auf die ersten öffentlichen Tests sicherlich noch einige Monate, wenn nicht sogar länger, warten müssen.

Eine bessere KI erfordert zwangsläufig bessere Hardware

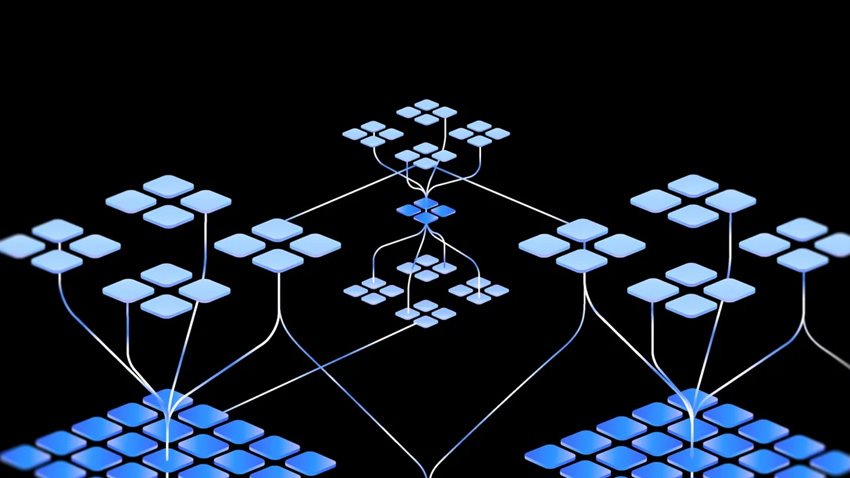

Die Nachfrage nach Hardware, die blitzschnelle Berechnungen für künstliche Intelligenz durchführen kann, ist in den letzten Jahren exponentiell gestiegen, und ein Ende scheint nicht in Sicht. Aus diesem Grund hat Google seine neue Serie TPU (tensor processing unit, spezielle Chips zur Beschleunigung von Tensorberechnungen, verwendet in der KI) namens Trillium vorgestellt. Es soll 4,7-mal leistungsstärker sein als die Vorgängergeneration. Die Chips werden den Nutzern der Google Cloud-Plattform bis Ende 2024 zur Verfügung stehen. Benutzerdefinierte physische Versionen der TPU-Chips waren in der Vergangenheit nicht verfügbar, und Google hat noch keine Pläne gezeigt, dies zu ändern.

- Google Gemini ist der neue große Fisch im Meer der künstlichen Intelligenz

- Google Pixel 8a (VORSTELLUNG): Mittelklasse mit Flaggschiff- Ausstattung und 7 Jahre Unterstützung

- Google Pixel 8 Pro (TEST): Ein großartiger, aber vorhersehbarer Nachfolger der Pixel-Serie

- Der Entwicklungszyklus von Android 15 beginnt. Worauf können wir uns freuen?

- Google Pixel 7a (REVIEW): Das neueste "A"-Modell hat ein großes Upgrade erhalten

- OnePlus 11 5G (REVIEW): es geht nicht bis an die Grenzen, kann aber eine Menge

- Samsung Galaxy S24 und S24+ (TEST): Die künstliche Intelligenz ist da. Welchen der beiden Brüder soll man wählen?

- Weitere Artikel in der Kategorie Handys

Google hat die gesamten zwei Stunden der Google I/O 2024-Präsentation der künstlichen Intelligenz gewidmet, und wie wir sehen, mangelte es nicht an Neuerungen. Obwohl Google erst letztes Jahr richtig in den KI-Wettlauf eingestiegen ist, ist es dank seiner riesigen Ressourcen immer noch in der Lage, die Grenzen zu verschieben, und wir können nur abwarten, wohin die künstliche Intelligenz als nächstes gehen wird.

Google HandysGoogle I/O 2023

Die diesjährige Eröffnungs-Keynote der Google I/O stand ganz im Zeichen der künstlichen Intelligenz. Aber auch sonst hat das Unternehmen nicht gezögert, einige Hardware vorzustellen. Worauf hat sich Google vor allem konzentriert?

Google I/O 2023 - INHALT

- Beeindruckende künstliche Intelligenz von Google

- Mit dem neuen Android 14 haben Sie mehr Kontrolle über Ihre Produkte

- Google Pixel 7a als günstigeres Pixel 7 mit fast identischer Ausstattung

- Das Google Pixel Fold ist das erste flexible Smartphone des Unternehmens

Beeindruckende künstliche Intelligenz von Google

Künstliche Intelligenz spielt eine große Rolle in unserem Leben und wird sich in Zukunft in fast alles, was wir kennen, integrieren. Aus diesem Grund wurde in der Einleitung der Konferenz häufig die Abkürzung AI verwendet.

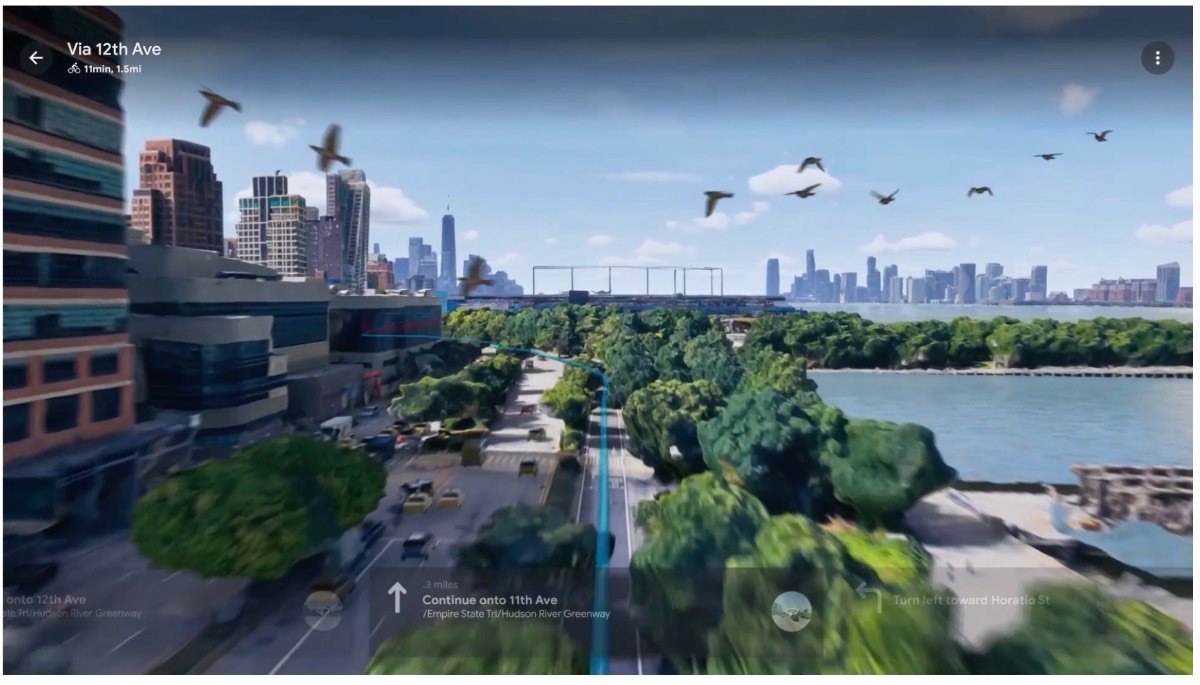

Google wird sie nutzen, um seine Dienste zu verbessern. Mit der Funktion "Help me write" von Google Mail können Sie einen Eingabebefehl (eine so genannte Eingabeaufforderung - prompt) eingeben und Gamil schreibt die E-Mail für Sie. Google Maps kann Ihre geplante Route dreidimensional navigieren. Es fügt sogar Autos oder Vögel am Himmel in das Bild ein.

Künstliche Intelligenz wird in großem Umfang im Bereich der Fotografie eingesetzt. Es ist also keine Überraschung, dass Google Photos mit neuen Funktionen ausgestattet wird. Im Magic Editor können Sie zum Beispiel ein Objekt, das an den Rändern verschwindet, in die Mitte des Rahmens verschieben. Der Editor berechnet den Rest des Fotos und passt die Helligkeit an, um das Ergebnis realistisch zu gestalten. Google beschränkt sich aber nicht auf E-Mails, Landkarten und Fotos. Das Unternehmen hat sich verpflichtet, KI für Dinge einzusetzen, die der Gesellschaft zugute kommen.

i

Eine Zusammenfassung der Keynote in englischer Sprache vom CEO selbst können Sie im Google-Blog lesen.

PaLM 2 ist die nächste Generation des groß angelegten Sprachmodells. Es wird Google Bard antreiben, einen Chatbot, der mit dem weltberühmten ChatGPT konkurriert. PaLM 2 kann Fehler in Programmiersprachen beheben. Es wurde auf zwanzig solcher Sprachen trainiert. In Fragen des Gesundheitswesens war das Modell in der Lage, so gut zu arbeiten, dass es die Expertenebene erreichte. Da Google erkannt hat, dass KI-Ergebnisse identifiziert werden müssen, bietet es Schutz in Form von Wasserzeichen und integrierten Metadaten. KI wird auch in die Suche und in Android Handys Einzug halten.

Mit dem neuen Android 14 haben Sie mehr Kontrolle über Ihre Produkte

Das Betriebssystem von Google kommt in seiner 14. Version. Mehr als 50 Google-Apps wurden an immer größere Bildschirmgrößen der Smartphones und Tablets angepasst - z. B. Spotify, Minecraft oder Disney+. Es wird auch an das neue Google Pixel Fold Tablet angepasst werden. Außerdem gibt es Neuigkeiten zu Wear OS, dem System für die Google Pixel Watch oder Samsung Galaxy Watch. Die WhatsApp wird nun zum System hinzugefügt. Auch bei Gmail und Kalender wird es Änderungen geben.

Android kann auf eine riesige Basis von Geräten zurückgreifen. Dies kann jedoch dazu führen, dass sie fragmentiert sind, weshalb Google darüber nachdenkt, sie in Android 14 besser zu verbinden. Zum Beispiel wird Fast Pair den Prozess der Kopplung von Zubehör wie kabellosen Kopfhörern beschleunigen. Wenn Sie sich in der Nähe eines anderen unterstützten Geräts befinden, können Sie Dateien sofort mit diesem Gerät austauschen, und es funktioniert auch zwischen Chromebook, Telefon und Tablet. Die App "Mein Gerät suchen" behält viele Ihrer Produkte geografisch im Auge, auch die von Drittherstellern.

Und wieder kommen wir zur KI. Android 14 wird die Nachricht selbst als Antwort auf die Chat-Konversation vorschreiben, und zwar in mehreren Varianten. Es schneidet ein Objekt aus dem Desktop-Bild heraus und lässt es in den unscharfen Hintergrund eintauchen. Dank der künstlichen Intelligenz können mehr Hintergrundbilder generiert werden. Und es wird etwas Einzigartiges sein, das noch niemand zuvor auf dem Desktop seines Telefons hatte. Der RCS-Standard ist auch für Telefone vorgesehen. Es soll eine moderne Art der Kommunikation sein, die SMS und MMS, wie wir sie kennen, ersetzt.

Google Pixel 7a als günstigeres Pixel 7 mit fast identischer Ausstattung

Bei der neuen Hardware handelt es sich um das Google Pixel 7a. Es soll der Nachfolger des Google Pixel 6a sein und fällt in die Smartphone-Mittelklasse. Es ähnelt in Aussehen und Funktion sehr dem derzeitigen Google Pixel 7, soll aber eine einfachere Version davon sein.

Auf den ersten Blick mag man den Unterschied kaum bemerken, aber das neue Modell hat ein kleineres 6,1-Zoll-Display und einen dickeren schwarzen Rahmen um das Display. Die Rückseite werden Sie schnell mit dem Pixel 7 verwechseln. Vielleicht deutet nur die blaue Version darauf hin, dass es sich um das neueste Pixel 7a handelt.

Dank des Google Tensor G2-Prozessors und 8 GB Arbeitsspeicher kann das Telefon in Sachen Leistung mit seinem teureren Bruder mithalten. Eine neue Funktion, die sicher gefallen wird und gleichzeitig den imaginären Wert des Geräts erhöht, ist sicherlich die Unterstützung für kabelloses Aufladen. Das Google Pixel 7a hat ebenfalls Vollgas gegeben und lässt sich auch von den Kameras nicht lumpen. Diese sind in der Pixelanzahl gewachsen.

Das Google Pixel Fold ist das erste faltbare Smartphone des Unternehmens

Die Spekulationen haben nicht gelogen. Google hat vor kurzem sein eigenes faltbaress Smartphone vorgestellt. Das Unternehmen betritt damit einen Markt, der vor allem vom Samsung Galaxy Z beherrscht wird. Das Google Pixel Fold ist nicht bescheiden und soll nach Angaben des Herstellers das beste Fotoerlebnis unter den faltbaren Handys bieten. Und dabei hat es in dem Samsung Galaxy Z Fold4 einen großen Wettbewerb. Im Vergleich zum koreanischen Modell sieht es wie ein Premium-Handy aus, das eine hohe Leistung und ein 7,6-Zoll-Display verbirgt.

Das Google Pixel Tablet mit einem 11-Zoll-Display ist ganz auf den Konsum von Inhalten ausgerichtet, woraus Google keinen Hehl macht. Auch dieses basiert auf dem Google Tensor G2 Prozessor. Die Ladestation dient auch als Ständer, aber auch als Lautsprecher. Das Tablet ist also nicht nur als Haushaltshilfe und Unterhaltungselement in einem nützlich. Eine enge Zusammenarbeit mit Pixel-Telefonen und Google-Diensten wie Google Fotos werden gefördert.

- Google Pixel 7a (VORSTELLUNG): Top-Chip, guter Preis und Funktionen, die nicht zu weit hinter seinem teureren Bruder zurückbleiben

- Das Android 12 ist da. Es bringt ein neues Design und größere Betonung der Privatsphäre

- Google Pixel Fold (VORSTELLUNG): Wie sieht das erste faltbare Gerät des Herstellers aus?

- Google Pixel 7 Pro (REVIEW): der amerikanische Hersteller hat sich wieder selbst übertroffen

- OnePlus 11 5G (REVIEW): es geht nicht bis an die Grenzen, kann aber eine Menge

- Samsung Galaxy S24 (SPEKULATION): Kehrt Exynos zurück?

- Weitere Artikel in der Kategorie Handys ohne Vertrag

Google sieht in der künstlichen Intelligenz eine Zukunft, versucht aber schon jetzt in ihre Geheimnisse einzudringen. Die vorgestellten Dienstleistungen und Produkte sind ein klarer Beweis dafür. Google hat seine Pläne enthüllt und wir freuen uns schon auf die Ankündigung neuer Flaggschiff-Smartphones für dieses Jahr.